Ces données figuraient à l’origine dans la newsletter du 7 juillet 2022 que vous trouverez ici : https://www.trustinsights.ai/blog/2022/07/inbox-insights-july-7-2022-outdated-plans-personal-branding-content-marketing-analytics/

Dans les journaux de données de cette semaine, essayons de résoudre un mystère d’analyse du marketing de contenu. Alors que je me préparais pour l’épisode de podcast de cette semaine, je suis tombé sur un article du début de l’année qui parlait des différents facteurs qui composent le contenu en ligne le plus performant. Cet article parlait de toutes sortes de mesures de marketing de contenu, des liens entrants à la longueur de l’article en passant par le sujet, présentant chaque type de données particulier comme étant important pour les performances du contenu.

L’article affirmait que les articles de plus de X longueurs faisaient mieux, les articles avec X nombre de liens faisaient mieux, etc. – des conseils de marketing de contenu assez courants. Cela a piqué ma curiosité. Dans quelle mesure ces affirmations sont-elles vraies ?

La première question que nous devons toujours nous poser est la suivante : est-ce un problème résoluble ? Existe-t-il un moyen de prouver que les affirmations de l’article sont vraies ou fausses ? Si nous suivons le processus de base du cycle de vie de la science des donnéesnous avons un objectif clair : identifier si l’un de ces facteurs de marketing de contenu a ou non une relation réelle avec le contenu le plus performant.

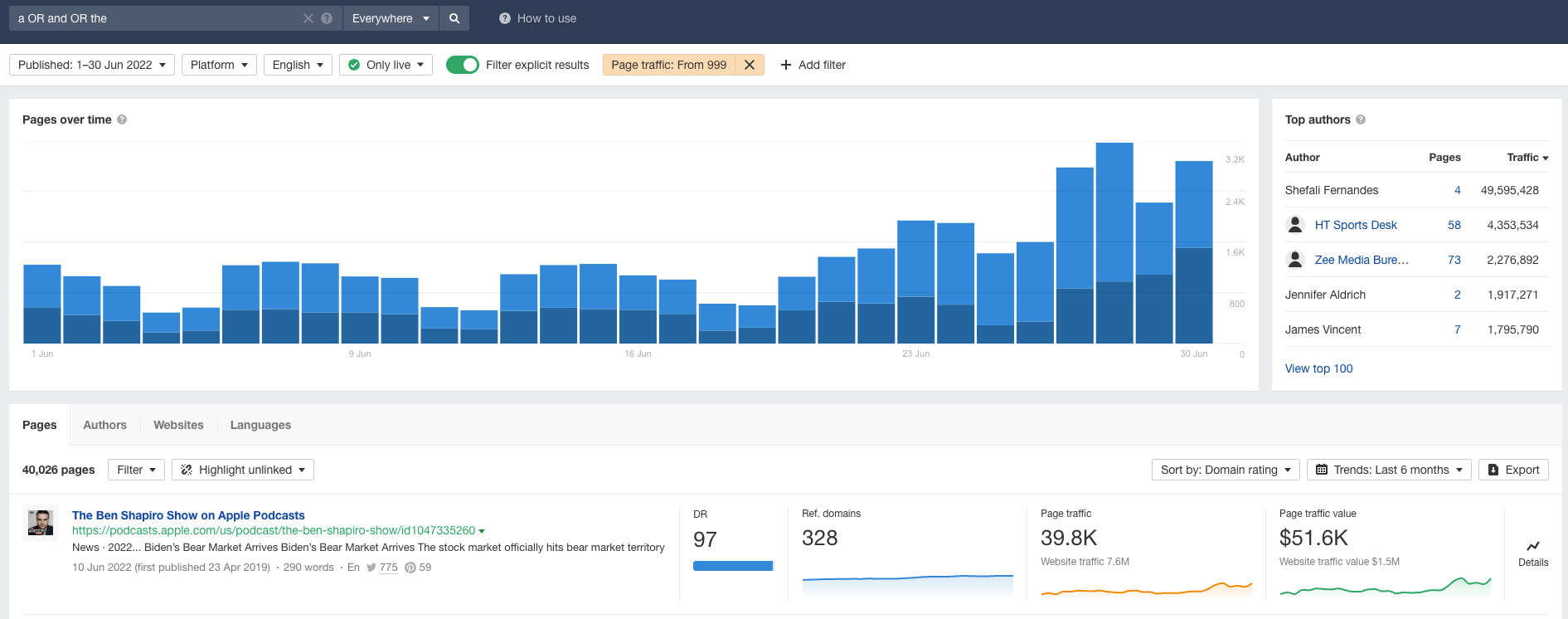

À partir de là, nous examinons les données dont nous disposons. Avec des outils de référencement comme AHREFS, Semrush, etc., nous pouvons examiner les performances générales du contenu public, en particulier le contenu public le plus performant, et voir des résultats clairs comme la quantité de trafic qu’un élément de contenu a gagné. Pour avoir une idée du contenu le plus important, nous commencerons par des articles utilisant les termes a, et, ou le – certains des mots les plus courants de la langue anglaise.

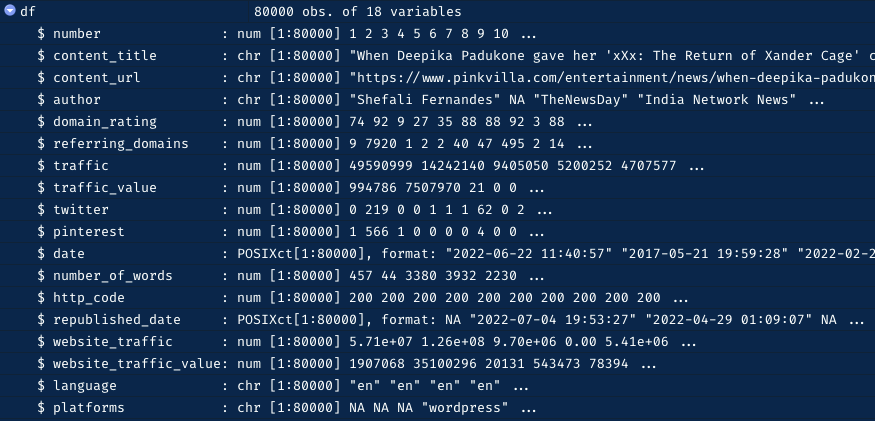

Avec un KPI clair et évident – le trafic – nous nous rapprochons grandement de la réponse à notre question. Ensuite, nous devons voir les données elles-mêmes. Quels champs y a-t-il et quels champs devrions-nous créer ?

Nous avons beaucoup de choix avec lesquels travailler et quelques choses dont nous devons nous débarrasser. Le numéro de ligne peut disparaître, tout comme le code HTTP. Nous devrions également regarder les sites par leur nom de domaine, comme nytimes.com ou cnn.com. Et nous pourrions vouloir considérer des choses comme l’heure de la journée, le jour de la semaine, etc.

Dans le cycle de vie de la science des données, il s’agirait de l’ingénierie des données : ingérer, analyser, réparer, nettoyer et préparer. Nous supprimerons également les variables qui sont des corrélats forts, qui n’apporteront aucune information supplémentaire, telles que la valeur du trafic (un corrélat du trafic) et la valeur du trafic du site Web (un corrélat du trafic du site Web). Dans les deux cas, ce sont des variables causales qui n’expliqueront rien – un site Web n’aura pas de valeur de trafic élevée sans trafic, et la valeur de trafic ne peut pas créer de trafic, au sens large.

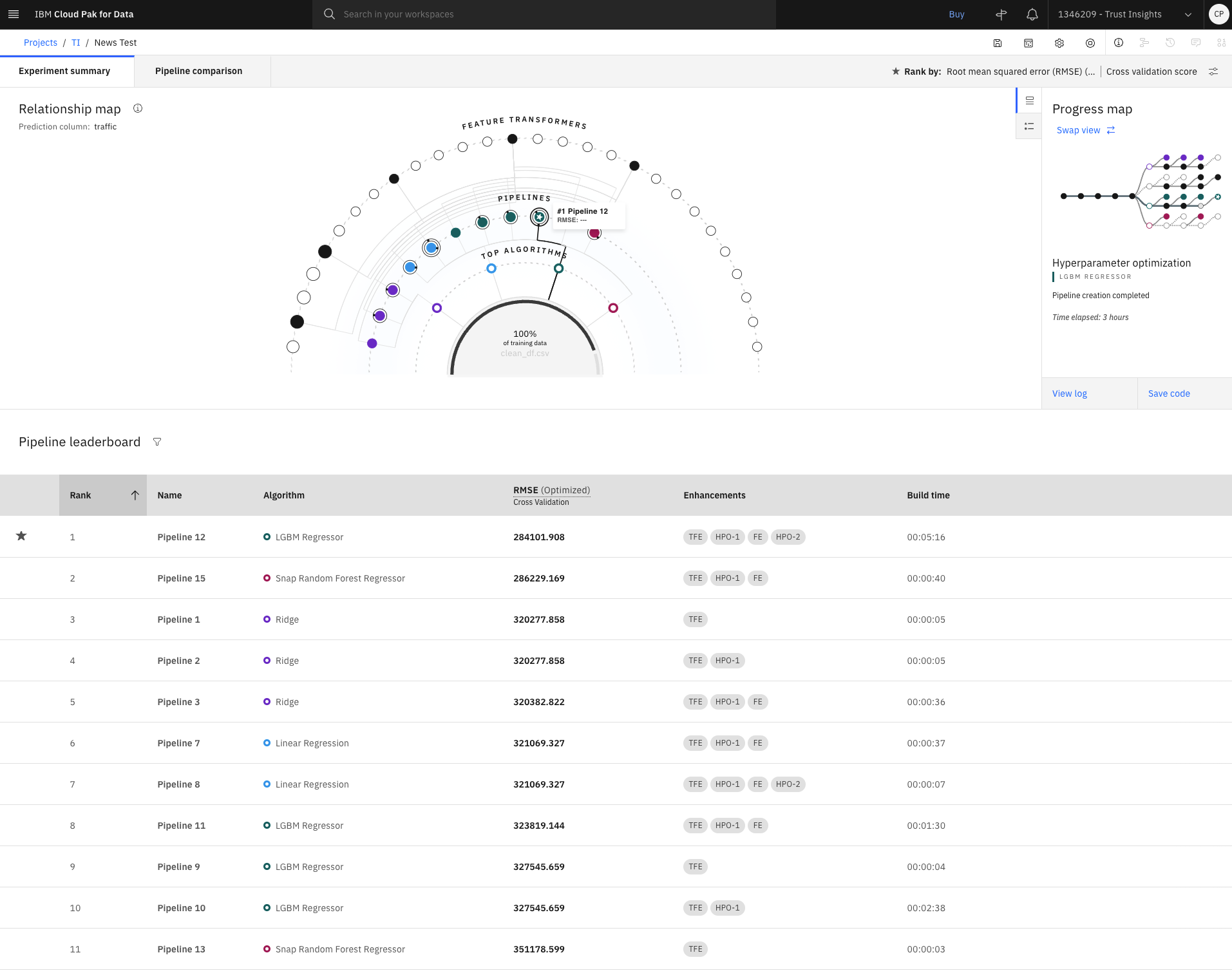

Une fois que nous sommes satisfaits de nos données, il est temps de passer la prochaine étape de notre processus aux machines, à un ensemble d’algorithmes d’apprentissage automatique appelé AutoAI d’IBM. Pourquoi? La prochaine étape du processus consiste à déterminer quelles variables, seules ou combinées, ont une relation statistique avec le résultat qui nous intéresse, le trafic. La meilleure pratique consiste à tester des dizaines d’algorithmes différents et à déterminer quels algorithmes correspondent le mieux à nos données, tout en tenant compte des problèmes courants de la science des données comme le surajustement (lorsque vous choisissez quelque chose qui correspond TROP bien à vos données d’échantillon et que les données du monde réel ne ça marche pas aussi).

Nous pourrions le faire à la main, mais des systèmes comme IBM Watson AutoAI l’ont déjà automatisé :

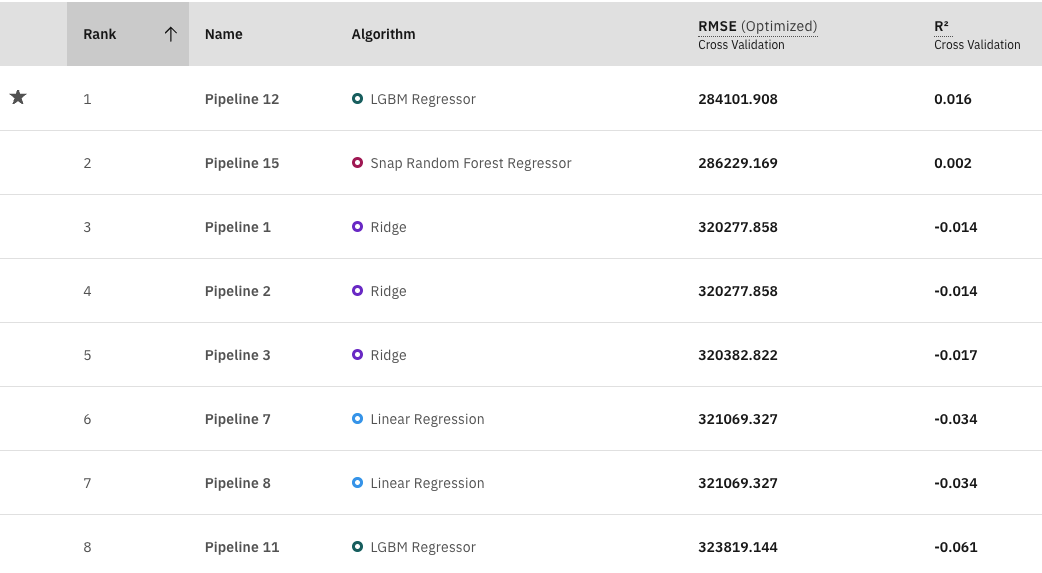

Bien qu’il s’agisse d’une visualisation intéressante de la façon dont Watson a fait ses choix, nous devons examiner spécifiquement les résultats :

Ce que nous voyons sont deux mesures de précision, RMSE – erreur quadratique moyenne – et R-carré. En termes trop simplifiés, RMSE mesure à quel point nos modèles varient en précision et R-carré explique à quel point nos modèles décrivent les données. R au carré est mesuré de -1 à +1 ; plus on se rapproche des extrêmes, meilleur est l’ajustement.

Qu’est-ce que cela nous dit? Bref, ça nous dit que aucune des variables que nous avons fournies n’a de pouvoir descriptif ou prédictif pour le trafic. Pas le nombre de mots, pas les partages sociaux, pas même les domaines de liaison entrants dans cet ensemble de données ne prédiront avec précision le trafic – ce qui signifie que nous aurions du mal à décrire une relation causale.

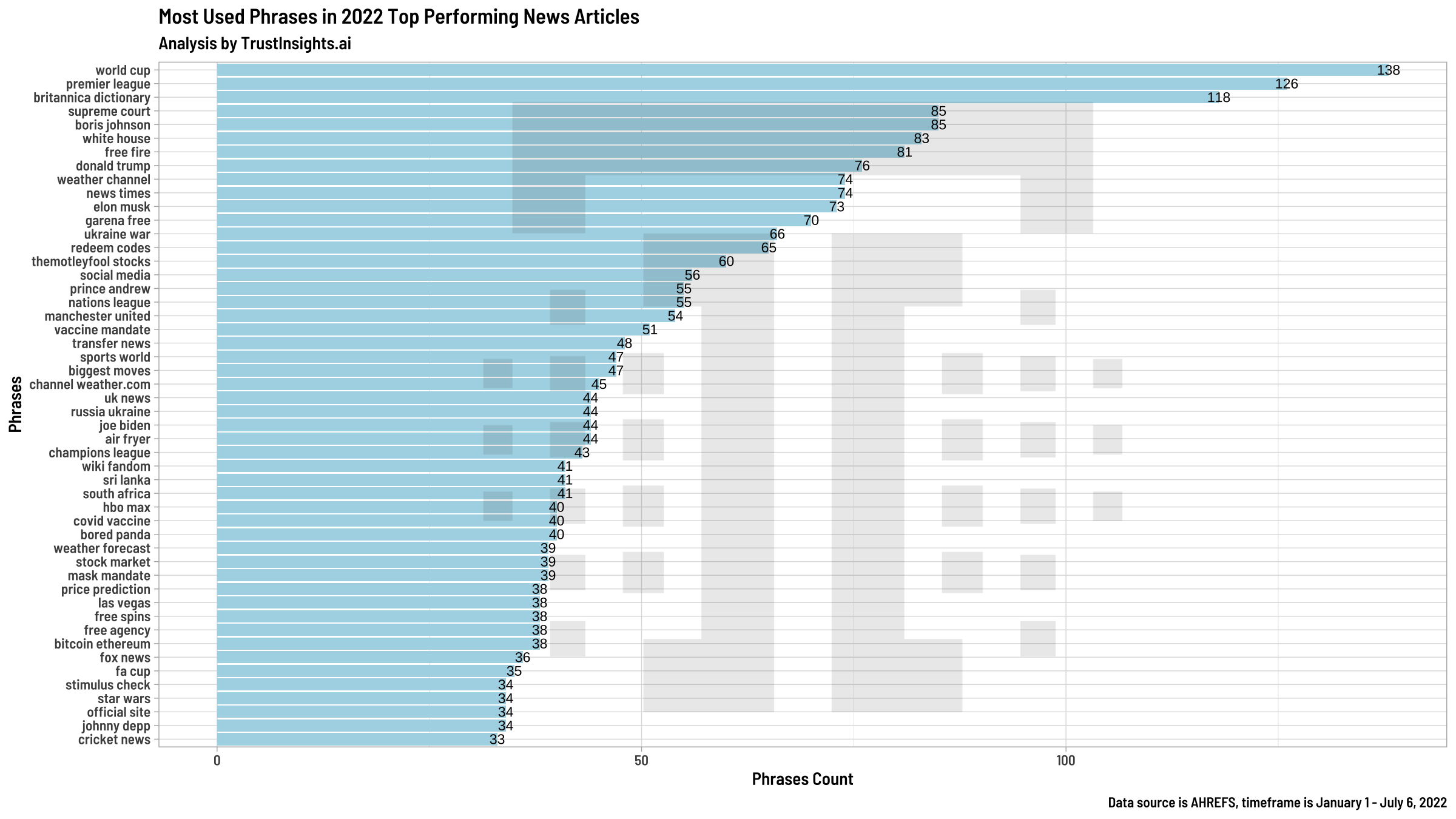

Pourquoi? Pourquoi ces facteurs éprouvés n’auraient-ils pas de relation avec le trafic alors que chaque publication de marketing de contenu sur la planète nous dit qu’ils sont importants ? Parce que le contenu le plus populaire n’est pas déterminé par des mesures techniques. Elle est motivée par des externalités – en particulier, les événements actuels. Jetons un coup d’œil aux fréquences d’expression dans cet ensemble de données du contenu le plus trafiqué :

Nous voyons clairement que ce sont tous des événements externes. Vous pourriez n’avoir aucune des meilleures pratiques en matière de marketing de contenu en jeu tant que vous créeriez du contenu sur ces événements – l’invasion illégale de l’Ukraine par la Russie, la Coupe du monde, le COVID, la Cour suprême – et votre contenu fonctionnerait bien.

Et alors? Le danger de regarder le contenu le plus performant en fonction d’attributs dont vous n’avez pas prouvé la valeur est que vous pouvez passer beaucoup de temps à optimiser ce contenu pour des choses qui n’ont peut-être pas d’importance. Les articles qui donnent des conseils généraux sur ce qui fonctionne dans le contenu doivent révéler exactement quel contenu a été analysé afin que nous puissions tous juger si ces caractéristiques sont importantes ou non.

La question de suivi logique est la suivante : ces caractéristiques sont-elles importantes pour le contenu qui ne fait pas partie des principales actualités ? La réponse serait de répéter le même processus, mais en utilisant un ensemble de données plus ciblé plutôt que les meilleurs articles de presse.

Méthodologie : Trust Insights a extrait 23 937 articles uniques de l’outil de référencement AHREFS sur la base des mots clés a, et, et le en anglais, à l’exclusion du contenu explicite. La période de collecte des données est du 1er janvier 2022 au 4 juillet 2022. La date de l’étude est le 6 juillet 2022. Trust Insights est le seul sponsor de l’étude et n’a ni donné ni reçu de compensation pour les données utilisées, au-delà des frais de service applicables à éditeurs de logiciels et ne déclare aucun intérêt concurrent.

|

Besoin d’aide avec vos données et analyses marketing ? |

Vous pourriez également profiter de : |

|

Obtenez des données, des analyses et des perspectives uniques sur l’analyse, les informations, l’apprentissage automatique, le marketing et l’IA dans la newsletter hebdomadaire Trust Insights, INBOX INSIGHTS. Abonnez-vous maintenant gratuitement ; nouveaux numéros tous les mercredis! |

Vous souhaitez en savoir plus sur les données, les analyses et les informations ? Abonnez-vous à In-Ear Insights, le podcast Trust Insights, avec de nouveaux épisodes de 10 minutes ou moins chaque semaine. |